L’article traite d’un enjeu clé des transformations actuelles : l’intégration de l’IA dans les organisations.

Formations aux outils, ateliers de prise en main, cas d’usage opérationnels. Les entreprises investissent pour acculturer leurs équipes à l’intelligence artificielle. Et pourtant, un décalage apparaît rapidement.

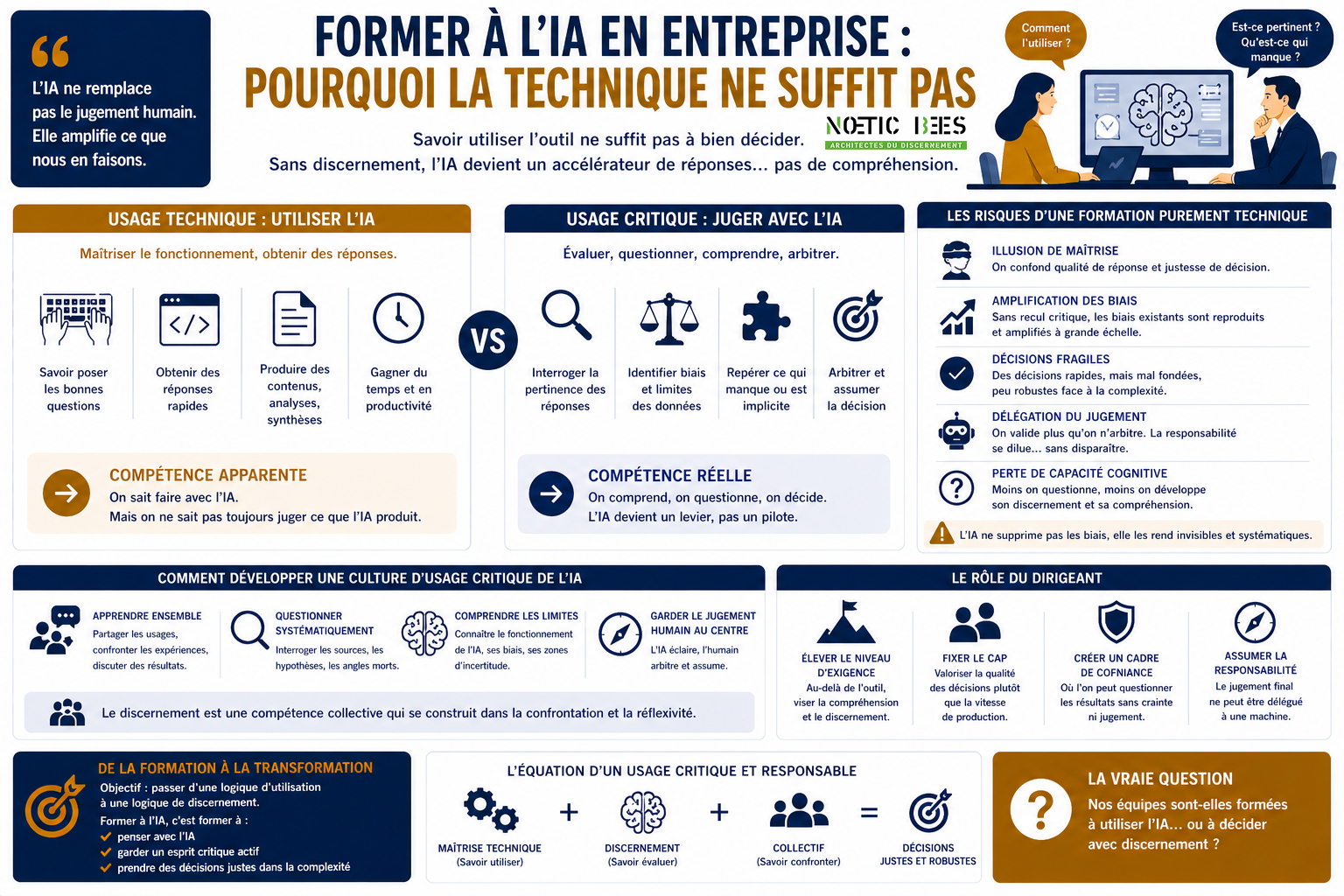

Les usages se développent. La qualité des décisions, beaucoup moins. Le problème n’est pas l’absence de formation. C’est ce que ces formations produisent réellement.

Dans la majorité des cas, former à l’IA consiste à apprendre à s’en servir.

Cette approche est logique. Elle permet une montée en compétence rapide. Mais elle repose sur une hypothèse implicite : Que savoir utiliser l’outil suffit à en tirer de la valeur. Et c’est précisément là que la limite apparaît.

L’usage technique consiste à maîtriser le fonctionnement. Savoir interroger l’IA, obtenir des réponses, produire des contenus. L’usage critique, lui, consiste à évaluer. Comprendre les limites, questionner les résultats, juger la pertinence.

Autrement dit :

Cette distinction est décisive.

Car une organisation peut être très compétente techniquement… et très fragile dans ses décisions.

Les formations techniques produisent des effets visibles. Les équipes deviennent plus rapides, plus productives, plus autonomes. Elles savent générer des analyses, produire des synthèses, structurer des recommandations. Mais cette compétence est souvent superficielle.

Car elle ne garantit pas :

L’organisation devient performante… en apparence.

Utiliser l’IA ne pose pas seulement une question de compétence. Cela pose une question de jugement.

Or ces questions ne sont presque jamais travaillées dans les formations. On apprend à produire.

Pas à évaluer.

Former techniquement donne un sentiment d’autonomie. Les équipes peuvent avancer seules, produire rapidement, répondre à des demandes. Mais cette autonomie est fragile. Car elle repose sur une dépendance implicite : La confiance dans les réponses produites. Sans capacité critique, cette confiance devient un risque.

Parce que l’IA ne pose pas seulement un problème d’usage. Elle transforme la manière de penser.

Elle modifie :

Former uniquement à la technique revient à ignorer cette transformation.

Face à l’IA, la compétence décisive n’est pas technique. Elle est cognitive.

Le discernement permet de :

Il transforme l’IA en levier. Sans lui, elle devient un risque.

Former individuellement ne suffit pas. Car l’enjeu n’est pas seulement d’utiliser l’IA. C’est de penser avec elle. Cela suppose un travail collectif :

C’est dans cette dynamique que la maturité se développe.

Le dirigeant peut être tenté d’accélérer l’adoption. Former vite, déployer largement, équiper les équipes. Mais cette logique peut être contre-productive. Car elle crée une illusion de compétence.

Le rôle réel est différent :

Ce rôle est stratégique.

Former à l’IA ne peut pas se limiter à transmettre des compétences techniques. Cela doit devenir un levier de transformation cognitive.

Passer de : "Comment utiliser l’IA ?" à : "Comment penser avec l’IA ?"

Ce déplacement change tout.

Un usage critique de l’IA se manifeste dans des situations précises.

Ce sont ces pratiques qui font la différence.

Former à la technique est simple. C’est structuré, mesurable, reproductible. Former au discernement est plus exigeant.

Cela implique :

C’est moins confortable. Mais c’est indispensable.

Une organisation mature ne se définit pas par sa maîtrise des outils. Mais par sa capacité à les utiliser avec discernement.

Cela suppose de :

Former à l’IA ne consiste pas seulement à apprendre à s’en servir. C’est apprendre à ne pas s’y soumettre. La vraie question n’est donc peut-être pas : nos équipes savent-elles utiliser l’IA ? Mais plutôt : savent-elles encore penser lorsqu’elles l’utilisent ?