L’article traite d’un malentendu central sur l’IA : sa supposée neutralité.

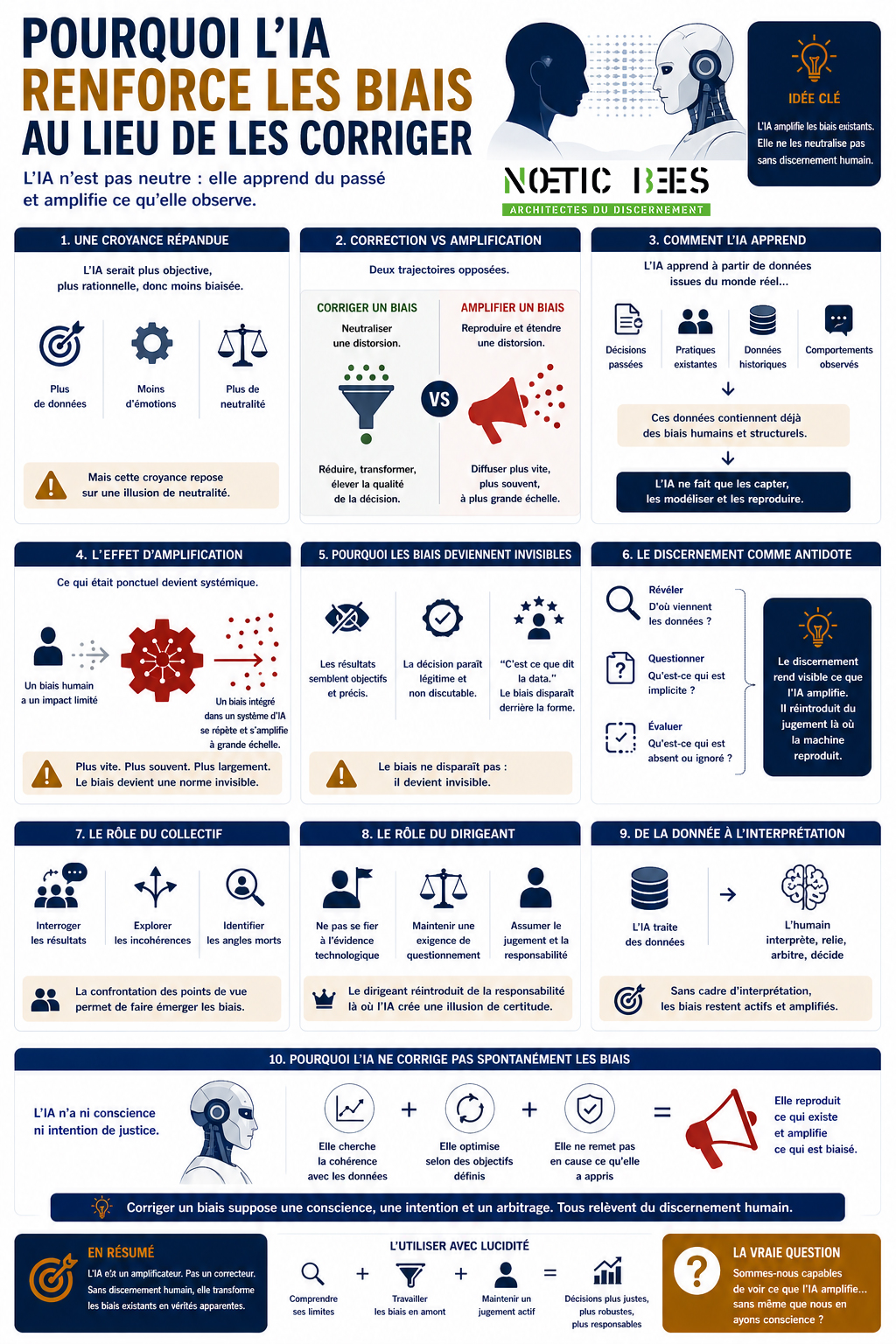

Dans les organisations, l’intelligence artificielle est souvent associée à une promesse implicite : Réduire les biais humains. Décider de manière plus rationnelle, plus neutre, plus fiable. Cette promesse est séduisante. Mais elle repose sur une illusion.

Car l’IA ne supprime pas les biais. Elle les prolonge.

Face aux biais cognitifs, les organisations cherchent des solutions. Et l’IA apparaît comme une réponse naturelle. Moins d’émotion, plus de données, plus de calcul. Donc, en théorie, moins de biais.

Mais cette logique suppose une chose : Que l’IA serait extérieure aux biais. Et c’est précisément là que le raisonnement se fragilise.

Corriger un biais, c’est le neutraliser. Identifier une distorsion et la réduire. L’amplifier, c’est la reproduire à plus grande échelle. L’intégrer dans un système qui la diffuse plus rapidement, plus largement.

Autrement dit :

Cette distinction est essentielle. Car l’IA ne transforme pas spontanément les biais. Elle apprend à partir d’eux.

L’IA fonctionne par apprentissage. Elle analyse des données passées pour produire des réponses présentes. Mais ces données ne sont pas neutres. Elles sont le reflet :

L’IA ne fait que capter ces régularités. Et les reproduire.

Parce que l’IA repose sur des modèles mathématiques, elle donne une impression d’objectivité. Les résultats semblent fondés, argumentés, rationnels. Mais cette objectivité est trompeuse.

Car elle masque une réalité : Les biais sont intégrés dans les données. Et donc dans les résultats. L’IA ne “voit” pas les biais. Elle les apprend.

Ce qui rend le phénomène critique, ce n’est pas seulement la reproduction. C’est l’amplification. Une décision biaisée prise ponctuellement a un impact limité. Une décision biaisée intégrée dans un système automatisé… Se répète à grande échelle. Plus vite. Plus souvent. Plus largement. Le biais devient systémique.

L’un des effets les plus dangereux est la disparition du doute. Une décision humaine peut être questionnée. Une décision produite par un système est souvent perçue comme légitime. “C’est ce que dit la data.”

Le biais ne disparaît pas. Il devient invisible. Et donc plus difficile à corriger.

Le discernement permet de rendre visible ce qui ne l’est pas. Il consiste à questionner :

Ce travail est essentiel. Car sans lui, l’IA fonctionne en boucle. Elle apprend des biais… et les renforce.

Face à l’IA, le risque est l’acceptation silencieuse. On prend la réponse comme donnée. On l’intègre sans la discuter. Le collectif doit jouer un rôle différent :

C’est dans cette confrontation que les biais peuvent apparaître.

Le dirigeant pourrait être tenté de s’appuyer sur l’IA pour objectiver. Rendre les décisions plus “neutres”, plus “rationnelles”. Mais cette posture peut être dangereuse. Car elle repose sur une confiance implicite. Le rôle réel est de maintenir une exigence :

Ce rôle est essentiel. Car il réintroduit de la responsabilité.

L’IA traite des données. Mais une décision ne repose pas uniquement sur des données. Elle repose sur leur interprétation. Et cette interprétation dépend d’un cadre. Sans ce cadre, les biais restent actifs. Et parfois renforcés.

Parce qu’elle n’a pas d’intention. Elle ne cherche pas à être juste. Elle cherche à être cohérente avec ce qu’elle a appris. Corriger un biais suppose :

Autant d’éléments qui relèvent du discernement humain.

L’enjeu n’est pas de rejeter l’IA. Mais de changer de posture. Ne pas la considérer comme une solution. Mais comme un amplificateur. Cela implique de :

L’IA devient alors un révélateur. Pas un correcteur. L’intelligence artificielle ne supprime pas les biais. Elle les rend plus puissants. La vraie question n’est donc peut-être pas : comment rendre l’IA plus objective ? Mais plutôt : sommes-nous capables de voir ce qu’elle amplifie… sans même que nous en ayons conscience ?